Czym jest machine learning (uczenie maszynowe)?

Machine learning, czyli uczenie maszynowe, to dziedzina sztucznej inteligencji (AI), w której komputery uczą się na podstawie danych, zamiast być jawnie programowane do wykonywania konkretnych zadań. Zamiast pisać reguły typu „jeśli X, to Y", programista dostarcza algorytmowi dużą ilość danych, a ten samodzielnie odkrywa wzorce i zależności, które pozwalają mu podejmować decyzje lub dokonywać prognoz.

Uczenie maszynowe otacza nas na każdym kroku, nawet jeśli nie zdajemy sobie z tego sprawy. Gdy Netflix rekomenduje film, Gmail filtruje spam, Google Translate tłumaczy zdanie, Tesla prowadzi samochód, a Spotify tworzy spersonalizowaną playlistę — za każdym z tych procesów stoją algorytmy machine learning. Według raportu McKinsey z 2025 roku, sztuczna inteligencja i uczenie maszynowe generują globalnie wartość rzędu 13 bilionów dolarów rocznie.

W tym przewodniku wyjaśnimy, jak działa machine learning, jakie są jego główne rodzaje, gdzie jest stosowany, jakich narzędzi potrzebujesz, aby zacząć, i jak uczenie maszynowe wpływa na nasze codzienne życie. Jeśli interesują Cię technologie, na których opiera się AI, przeczytaj nasz artykuł o procesorach CPU — sercu każdego komputera.

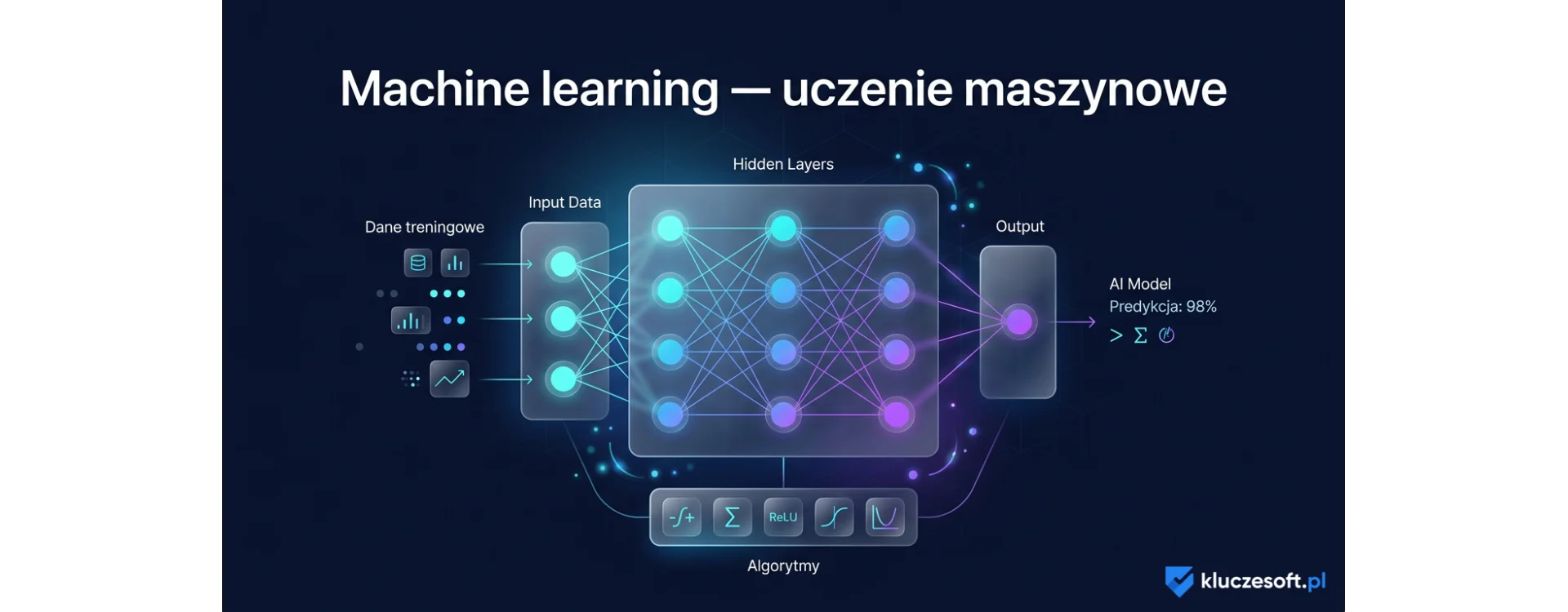

Jak działa machine learning — od danych do modelu

Proces uczenia maszynowego można porównać do tego, jak uczy się człowiek. Dziecko nie dostaje listy reguł „co to jest kot" — zamiast tego widzi setki zdjęć kotów i stopniowo uczy się rozpoznawać wspólne cechy. Machine learning działa podobnie, ale na skalę milionów lub miliardów przykładów.

Etapy procesu ML

- Zbieranie danych — gromadzenie dużych zbiorów danych treningowych (zdjęcia, tekst, liczby, dźwięki)

- Przygotowanie danych — czyszczenie, normalizacja, podział na zbiór treningowy i testowy

- Wybór algorytmu — dobór odpowiedniego modelu do problemu (klasyfikacja, regresja, klasteryzacja)

- Trening modelu — algorytm analizuje dane treningowe i dostosowuje swoje parametry, minimalizując błędy

- Ewaluacja — sprawdzanie jakości modelu na danych testowych, których model wcześniej nie widział

- Optymalizacja — dostrajanie hiperparametrów, walka z przeuczeniem (overfitting)

- Wdrożenie — zastosowanie modelu w produkcji do przetwarzania nowych, rzeczywistych danych

Dane — paliwo machine learning

Jakość danych jest absolutnie kluczowa. Nawet najlepszy algorytm nie wytrenuje dobrego modelu na złych danych. W branży istnieje powiedzenie: „garbage in, garbage out" — śmieci na wejściu oznaczają śmieci na wyjściu. Dlatego przygotowanie danych (data preprocessing) zajmuje zwykle 60-80% czasu w projekcie ML.

Funkcja straty i optymalizacja

Serce uczenia maszynowego to minimalizacja funkcji straty (loss function). Funkcja straty mierzy, jak bardzo predykcje modelu różnią się od rzeczywistych wartości. Algorytm optymalizacji (najczęściej gradient descent — metoda spadku gradientu) iteracyjnie modyfikuje parametry modelu, aby zmniejszyć tę różnicę. Wyobraź sobie, że szukasz najniższego punktu w górach, idąc zawsze w dół — to właśnie robi gradient descent.

Rodzaje uczenia maszynowego

Machine learning dzieli się na kilka głównych kategorii, różniących się sposobem uczenia i typem danych, z których korzystają.

Uczenie nadzorowane (supervised learning)

Najpopularniejszy typ ML. Algorytm uczy się na danych z etykietami — każdy przykład treningowy ma przypisaną poprawną odpowiedź. Na przykład: zbiór zdjęć z etykietami „kot" lub „pies", albo dane historyczne sprzedaży z przypisanymi cenami. Algorytm uczy się mapowania danych wejściowych na wyjściowe.

Główne zadania uczenia nadzorowanego:

- Klasyfikacja — przypisywanie danych do kategorii (spam/nie-spam, choroba/brak choroby, kot/pies)

- Regresja — przewidywanie wartości ciągłej (cena mieszkania, temperatura, kurs akcji)

Popularne algorytmy: regresja liniowa, regresja logistyczna, drzewa decyzyjne, Random Forest, SVM (Support Vector Machine), sieci neuronowe.

Uczenie nienadzorowane (unsupervised learning)

W uczeniu nienadzorowanym dane nie mają etykiet — algorytm sam odkrywa struktury i wzorce w danych. Jest używane, gdy nie wiemy z góry, jakich kategorii szukamy.

Główne zadania:

- Klasteryzacja (clustering) — grupowanie podobnych obiektów (segmentacja klientów, grupowanie dokumentów)

- Redukcja wymiarowości — upraszczanie danych wielowymiarowych (PCA, t-SNE)

- Wykrywanie anomalii — identyfikacja danych odstających (fraud detection, wykrywanie usterek)

Popularne algorytmy: K-Means, DBSCAN, hierarchiczne grupowanie, PCA, Autoencoders.

Uczenie ze wzmocnieniem (reinforcement learning)

Agent (program) uczy się poprzez interakcję ze środowiskiem. Za dobre decyzje dostaje nagrody, za złe — kary. Z czasem uczy się strategii maksymalizującej łączną nagrodę. Ten typ ML stoi za sukcesami AlphaGo (gra w Go), robotyką i autonomicznymi pojazdami.

Deep learning (uczenie głębokie)

Deep learning to podzbiór machine learning oparty na głębokich sieciach neuronowych — modelach z wieloma warstwami przetwarzania. Inspirowane budową ludzkiego mózgu, sieci neuronowe potrafią automatycznie wykrywać złożone wzorce w danych. Deep learning zrewolucjonizował rozpoznawanie obrazów, przetwarzanie języka naturalnego (NLP), generowanie tekstu (ChatGPT, Claude) i syntezkę mowy.

| Rodzaj ML | Dane | Zastosowania | Przykłady algorytmów |

|---|

| Uczenie nadzorowane | Z etykietami | Klasyfikacja, regresja, prognozowanie | Random Forest, SVM, sieci neuronowe |

| Uczenie nienadzorowane | Bez etykiet | Segmentacja, wykrywanie anomalii | K-Means, DBSCAN, PCA |

| Uczenie ze wzmocnieniem | Nagrody/kary | Gry, robotyka, optymalizacja | Q-Learning, PPO, A3C |

| Deep learning | Duże zbiory | Obraz, tekst, mowa, generowanie | CNN, RNN, Transformer, GAN |

Zastosowania machine learning w praktyce

Uczenie maszynowe transformuje praktycznie każdą branżę. Oto najważniejsze i najbardziej widoczne zastosowania, z którymi stykamy się codziennie.

Rozpoznawanie obrazów i wideo

Sieci konwolucyjne (CNN) potrafią rozpoznawać twarze, obiekty, sceny i tekst na obrazach z dokładnością przewyższającą człowieka. Zastosowania: odblokowywanie telefonu twarzą (Face ID), autonomiczne samochody, diagnostyka medyczna (wykrywanie nowotworów na zdjęciach radiologicznych), kontrola jakości w fabrykach, systemy monitoringu.

Przetwarzanie języka naturalnego (NLP)

Modele językowe oparte na architekturze Transformer (GPT, Claude, Gemini, LLaMA) zrewolucjonizowały interakcję człowieka z komputerem. Potrafią rozumieć i generować tekst w dowolnym języku, tłumaczyć, podsumowywać, odpowiadać na pytania i prowadzić konwersację. NLP napędza chatboty, asystentów głosowych (Siri, Alexa), automatyczne tłumaczenia i analizę sentymentu.

Systemy rekomendacji

Netflix, YouTube, Spotify, Amazon — każda z tych platform używa machine learning do personalizacji treści. Algorytmy analizują Twoje zachowania (co oglądasz, słuchasz, kupujesz) i porównują je z zachowaniami milionów innych użytkowników, aby przewidzieć, co Ci się spodoba. Szacuje się, że 80% treści oglądanych na Netflix pochodzi z rekomendacji algorytmu.

Medycyna i ochrona zdrowia

ML wspiera diagnostykę medyczną (wykrywanie chorób na zdjęciach medycznych), odkrywanie leków (AlphaFold przewiduje struktury białek), personalizację terapii, prognozowanie epidemii i optymalizację procesów szpitalnych. AI w medycynie to jedna z najszybciej rozwijających się dziedzin.

Finanse i bankowość

Wykrywanie oszustw (fraud detection), ocena ryzyka kredytowego, algorytmiczny trading, chatboty obsługi klienta, personalizacja ofert bankowych — machine learning jest dziś fundamentem nowoczesnego sektora finansowego.

Bezpieczeństwo IT

Nowoczesne programy antywirusowe, takie jak Norton 360 Deluxe i Bitdefender Total Security, wykorzystują machine learning do wykrywania nieznanych zagrożeń. Algorytmy ML analizują zachowanie programów i identyfikują podejrzane wzorce, nawet jeśli dany malware nie jest jeszcze w bazie sygnatur. Dowiedz się więcej o zabezpieczeniu komputera przed wirusami.

Narzędzia i frameworki do machine learning

Ekosystem narzędzi ML jest dziś niezwykle bogaty. Niezależnie od poziomu zaawansowania, znajdziesz narzędzia odpowiednie do swoich potrzeb.

Języki programowania

- Python — zdominował ML dzięki prostej składni i bogatemu ekosystemowi bibliotek (NumPy, Pandas, Scikit-learn, TensorFlow, PyTorch). Ponad 80% projektów ML jest realizowanych w Pythonie

- R — silny w statystyce i wizualizacji danych, popularny w środowisku akademickim

- Julia — nowoczesny język łączący wydajność C++ z prostotą Pythona, zyskujący popularność w ML

- JavaScript — TensorFlow.js pozwala uruchamiać modele ML w przeglądarce

Jeśli chcesz poznać szerzej świat języków programowania, zapraszamy do lektury naszego artykułu o najpopularniejszych językach programowania.

Frameworki deep learning

- PyTorch — stworzony przez Meta (Facebook), dominuje w badaniach naukowych, intuicyjny, dynamiczny graf obliczeniowy

- TensorFlow / Keras — stworzony przez Google, szeroko stosowany w produkcji, bogaty ekosystem (TFLite, TF Serving)

- JAX — Google, wysoka wydajność, automatyczne różniczkowanie, kompilacja XLA

- Hugging Face Transformers — biblioteka modeli NLP, tysiące pretrenowanych modeli do pobrania

Platformy chmurowe

- Google Cloud AI / Vertex AI — AutoML, trenowanie modeli, hosting

- Amazon SageMaker — kompleksowa platforma ML na AWS

- Microsoft Azure ML — integracja z ekosystemem Microsoft i Office 2024

- Kaggle — platforma z danymi, konkursami i notebookami (część Google)

Wymagania sprzętowe

Machine learning, szczególnie deep learning, wymaga znacznej mocy obliczeniowej. Do trenowania dużych modeli potrzebne są karty graficzne (GPU) z dużą ilością pamięci VRAM — NVIDIA RTX 4090 to minimum dla poważniejszych projektów, a profesjonalne laboratoria AI używają kart A100 lub H100. Do nauki i prostszych modeli wystarczy laptop z Windows 11 Pro i przyzwoitą kartą graficzną — wiele zadań można też realizować w chmurze (Google Colab oferuje darmowe GPU).

Machine learning a sztuczna inteligencja — czym się różnią?

Terminy „sztuczna inteligencja" (AI), „machine learning" (ML) i „deep learning" (DL) są często używane zamiennie, ale mają różne znaczenia.

Hierarchia pojęć

AI to najszerszy termin — obejmuje wszystkie techniki, dzięki którym maszyny naśladują ludzką inteligencję. ML to podzbiór AI — konkretna metoda, w której maszyny uczą się z danych. Deep learning to podzbiór ML — uczenie przy użyciu głębokich sieci neuronowych. Wyobraź sobie to jako matrioszki: AI > ML > DL.

AI bez machine learning

Nie każdy system AI wykorzystuje machine learning. Systemy eksperckie (reguły if-then pisane ręcznie), wyszukiwanie w drzewach gier (klasyczne szachy komputerowe), algorytmy genetyczne — to przykłady AI, które nie są machine learningiem. Jednak współcześnie granica się zaciera — większość nowoczesnych systemów AI opiera się na ML.

Generative AI — nowa era

Generative AI (sztuczna inteligencja generatywna) to najnowszy przełom w machine learning. Modele takie jak GPT-4, Claude, Gemini, DALL-E, Midjourney i Stable Diffusion potrafią generować tekst, obrazy, muzykę, wideo i kod programistyczny na podstawie promptów tekstowych. Ta technologia zmienia sposób, w jaki pracujemy, tworzymy treści i rozwiązujemy problemy.

| Pojęcie | Zakres | Przykłady |

|---|

| Sztuczna inteligencja (AI) | Maszyny naśladujące ludzką inteligencję | Systemy eksperckie, roboty, chatboty |

| Machine learning (ML) | Uczenie z danych bez jawnego programowania | Filtry antyspamowe, rekomendacje, prognozy |

| Deep learning (DL) | Głębokie sieci neuronowe | Rozpoznawanie obrazów, NLP, ChatGPT |

| Generative AI | Generowanie nowych treści | GPT-4, DALL-E, Midjourney, Sora |

Jak zacząć naukę machine learning?

Uczenie maszynowe to dziedzina wymagająca solidnych podstaw matematycznych i programistycznych, ale dzięki nowoczesnym narzędziom i kursom online, start jest łatwiejszy niż kiedykolwiek.

Wymagane umiejętności

- Python — podstawowy język ML, nauka trwa kilka tygodni

- Matematyka — algebra liniowa (macierze, wektory), rachunek różniczkowy (gradient), statystyka (rozkłady, prawdopodobieństwo), teoria informacji

- Programowanie — struktury danych, algorytmy, praca z danymi (Pandas, NumPy)

- Wizualizacja danych — Matplotlib, Seaborn, Plotly

Ścieżka nauki

- Python i biblioteki danych — NumPy, Pandas, Matplotlib (2-4 tygodnie)

- Podstawy ML — Scikit-learn, klasyczne algorytmy (2-3 miesiące)

- Deep learning — PyTorch lub TensorFlow (2-3 miesiące)

- Specjalizacja — NLP, Computer Vision, Reinforcement Learning (ciągły rozwój)

- Projekty praktyczne — Kaggle, portfolio, aplikacje rzeczywiste

Rekomendowane zasoby

- Kursy online: Andrew Ng „Machine Learning" (Coursera), fast.ai (praktyczne podejście), Kaggle Learn (mini-kursy)

- Książki: „Hands-On Machine Learning" (Aurélien Géron), „Deep Learning" (Goodfellow, Bengio, Courville)

- Praktyka: Kaggle (konkursy i datasety), Google Colab (darmowe GPU), Hugging Face (modele)

Często zadawane pytania (FAQ)

Czy machine learning zastąpi programistów?

Machine learning nie zastąpi programistów, ale zmieni charakter ich pracy. Narzędzia AI (GitHub Copilot, Claude, GPT-4) mogą automatycznie generować kod, ale wciąż potrzebni są ludzie do definiowania problemów, projektowania systemów, weryfikacji kodu, testowania i utrzymania. Programiści, którzy nauczą się korzystać z narzędzi AI, będą znacznie bardziej produktywni, ale ci, którzy je zignorują, mogą stracić na konkurencyjności.

Ile danych potrzeba do trenowania modelu ML?

Zależy od złożoności problemu i typu algorytmu. Proste modele (regresja liniowa) mogą dawać dobre wyniki z setkami przykładów. Klasyczne algorytmy ML (Random Forest, SVM) wymagają zwykle tysięcy do dziesiątek tysięcy próbek. Deep learning wymaga znacznie więcej — od dziesiątek tysięcy do milionów przykładów. Techniki transfer learning pozwalają zmniejszyć te wymagania, wykorzystując pretrenowane modele.

Czy do machine learning potrzebuję drogiego sprzętu?

Do nauki i eksperymentowania wystarczy zwykły laptop z Windows 11 Pro. Google Colab oferuje darmowy dostęp do GPU (NVIDIA T4), co wystarcza do większości projektów edukacyjnych. Profesjonalne trenowanie dużych modeli wymaga dedykowanych GPU (NVIDIA RTX 4090, A100) lub usług chmurowych (AWS, GCP, Azure). Koszt trenowania dużych modeli językowych może sięgać milionów dolarów.

Co to jest overfitting i jak go unikać?

Overfitting (przeuczenie) to sytuacja, gdy model zbyt dobrze „zapamiętuje" dane treningowe zamiast uczyć się ogólnych wzorców. Taki model ma świetne wyniki na danych treningowych, ale radzi sobie źle z nowymi danymi. Metody zapobiegania: regularyzacja (L1/L2), dropout (w sieciach neuronowych), walidacja krzyżowa (cross-validation), wczesne zatrzymywanie treningu (early stopping), augmentacja danych i zbieranie większej ilości danych treningowych.

Jakie branże najbardziej korzystają z machine learning?

Praktycznie każda branża może korzystać z ML, ale największy wpływ widać w: technologii (rekomendacje, wyszukiwarki, asystenci AI), finansach (fraud detection, trading algorytmiczny), opiece zdrowotnej (diagnostyka, odkrywanie leków), e-commerce (personalizacja, prognozowanie popytu), motoryzacji (autonomiczne pojazdy), bezpieczeństwie IT (wykrywanie zagrożeń, antywirus) oraz produkcji (kontrola jakości, predykcyjne utrzymanie ruchu).

Podsumowanie — uczenie maszynowe zmienia świat

Machine learning to nie przyszłość — to teraźniejszość. Od filtrowania spamu w Twojej skrzynce e-mail po autonomiczne samochody, od diagnostyki medycznej po generowanie tekstu i obrazów — uczenie maszynowe fundamentalnie zmienia sposób, w jaki żyjemy, pracujemy i tworzymy.

Niezależnie od tego, czy chcesz zostać specjalistą ML, czy po prostu chcesz rozumieć technologię, która kształtuje współczesny świat — wiedza o machine learning jest dziś jedną z najcenniejszych kompetencji. Zacznij od Pythona, kursu Andrew Ng i eksperymentów na Kaggle. A jeśli potrzebujesz wydajnego środowiska do nauki i pracy — sprawdź ofertę Windows 11 Pro i Office 2024 Professional Plus w sklepie KluczeSoft.pl.

Najczesciej zadawane pytania

Co to jest uczenie maszynowe?

Uczenie maszynowe to dziedzina AI, w której algorytmy uczą się wzorców z danych bez jawnego programowania — np. rozpoznawanie obrazów, rekomendacje.

Jaki język programowania do machine learning?

Python z bibliotekami TensorFlow, PyTorch i scikit-learn. R jest popularny w analizie statystycznej.

Czy potrzebuję mocnego komputera do ML?

Do nauki wystarczy zwykły laptop. Do trenowania dużych modeli potrzebujesz GPU (NVIDIA RTX) lub usług chmurowych (Google Colab, Azure ML).

![Jak sprawdzić klucz produktu Windows 11 i Windows 10 — 5 metod [2026] Jak sprawdzić klucz produktu Windows 11 i Windows 10 — 5 metod [2026]](https://kluczesoft.pl/img/ybc_blog/post/thumb/thumb-132.jpg)

![100+ skrótów klawiszowych Windows 11 i 10 — kompletna ściąga [2026] 100+ skrótów klawiszowych Windows 11 i 10 — kompletna ściąga [2026]](https://kluczesoft.pl/img/ybc_blog/post/thumb/hero-26.png)

![Jak przyspieszyć Windows 11 — 15 sprawdzonych metod [2026] Jak przyspieszyć Windows 11 — 15 sprawdzonych metod [2026]](https://kluczesoft.pl/img/ybc_blog/post/thumb/hero-213.png)

![Kalkulator licencji Windows Server — oblicz ile potrzebujesz [2026] Kalkulator licencji Windows Server — oblicz ile potrzebujesz [2026]](https://kluczesoft.pl/img/ybc_blog/post/thumb/hero-339.png)

![Licencja OEM vs ESD vs BOX vs Retail — kompletne porownanie z infografika [2026] Licencja OEM vs ESD vs BOX vs Retail — kompletne porownanie z infografika [2026]](https://kluczesoft.pl/img/ybc_blog/post/thumb/hero-338.png)

Dodaj komentarz